MCP 프로토콜: 음성 노트가 AI 에이전트 워크플로에 통합되는 방법

Model Context Protocol(MCP)이 음성 녹음을 AI 에이전트의 실시간 데이터 소스로 변환하는 방법을 알아보세요.

Model Context Protocol이란?

Model Context Protocol(MCP)은 AI 모델이 구조화된 인터페이스를 통해 외부 데이터와 도구에 접근할 수 있게 하는 오픈 표준입니다. 모든 AI 애플리케이션이 각 데이터 소스에 대한 커스텀 통합을 구축하는 대신, MCP는 AI 에이전트가 정보를 발견, 쿼리, 조작할 수 있는 공통 언어를 제공합니다.

음성 데이터에 이것은 혁명적입니다. 회의 녹음, 음성 메모, 전사된 노트에는 워크플로에서 가장 풍부한 컨텍스트가 담겨 있습니다. MCP는 이 컨텍스트를 AI 에이전트가 검색, 검색, 추론할 수 있게 합니다.

음성 데이터가 AI 에이전트의 이상적인 입력인 이유

대부분의 지식 노동은 대화를 통해 이루어집니다. 회의, 전화, 브레인스토밍 — 가장 중요한 결정은 말로 하는 것이지, 타이핑하는 것이 아닙니다.

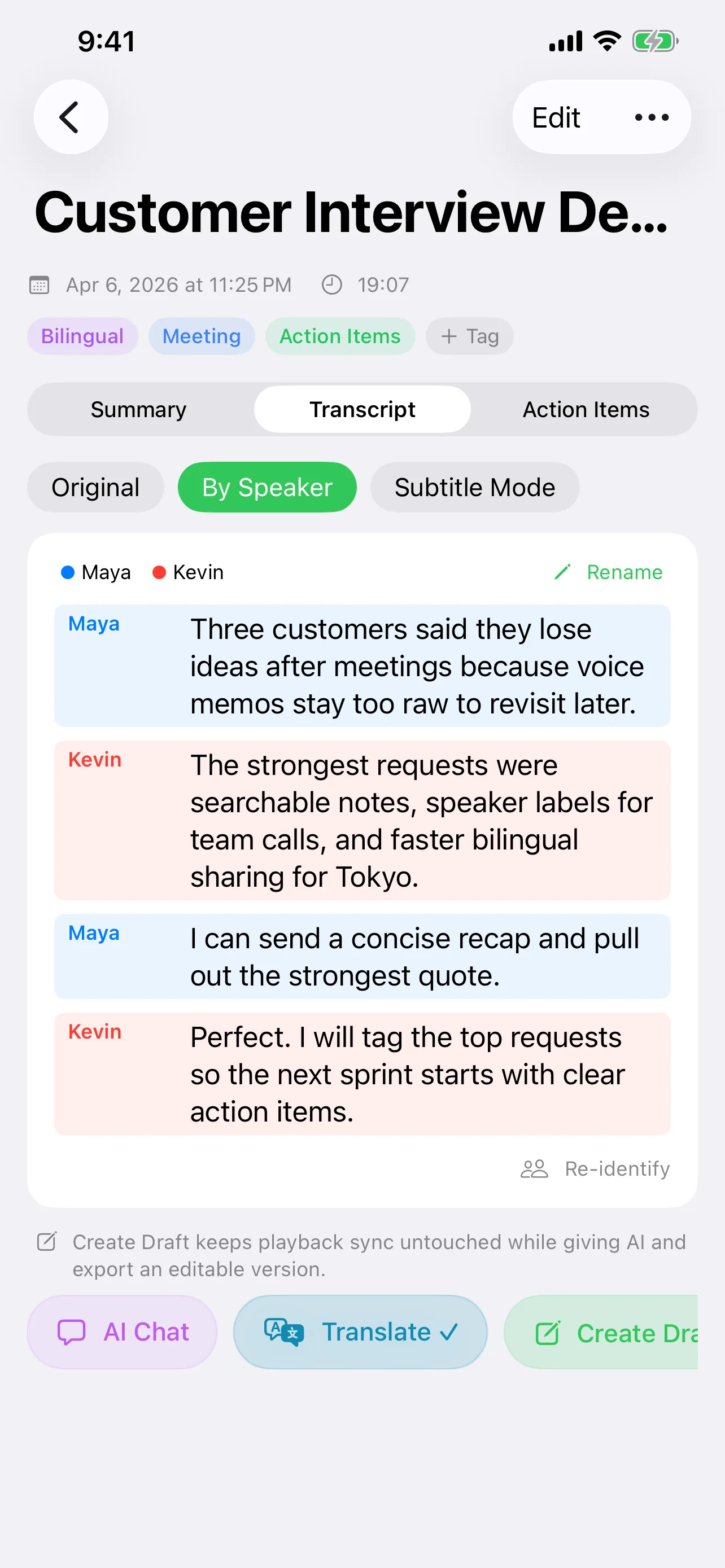

- 시간적 컨텍스트 — 음성 노트에는 타임스탬프가 있어 결정이 언제, 누구에 의해 내려졌는지 추적 가능.

- 필터링되지 않은 디테일 — 서면 요약과 달리 전사본은 뉘앙스, 이견, 추론 과정을 포함한 전체 대화를 캡처.

- 정보량 — 사람은 타이핑보다 약 4배 빠르게 말합니다. 음성은 분당 다른 어떤 입력 방식보다 훨씬 많은 정보를 캡처.

Speechy의 MCP 구현

Speechy는 MCP SDK(v0.12.0+)를 통합하여 음성 노트 라이브러리를 MCP 호환 AI 에이전트가 호출할 수 있는 도구 세트로 노출합니다:

search_notes— 모든 전사 노트의 전문 검색. 에이전트가 "Q2 로드맵을 논의한 모든 회의 찾기"를 쿼리하면 타임스탬프가 포함된 관련 전사 세그먼트를 반환.search_memories— 대화 간 컨텍스트를 유지하는 AI 메모리 시스템 쿼리. 무엇이 말해졌는지뿐만 아니라 시간이 지나면서 어떤 패턴과 테마가 나타나는지 이해 가능.

실제 활용 시나리오

시나리오 1: 회의 전 브리핑 — 정기 팀 회의 전에 AI 에이전트가 Speechy 노트를 쿼리: "지난 주 회의에서 할당된 액션 아이템은? 아직 미완료인 것은?"

시나리오 2: 결정 사항 추적 — 3주 전 회의의 결정을 확인해야 할 때, AI 에이전트가 MCP를 통해 노트 검색: "기능 X를 제거하기로 결정한 게 언제였지? 이유는?"

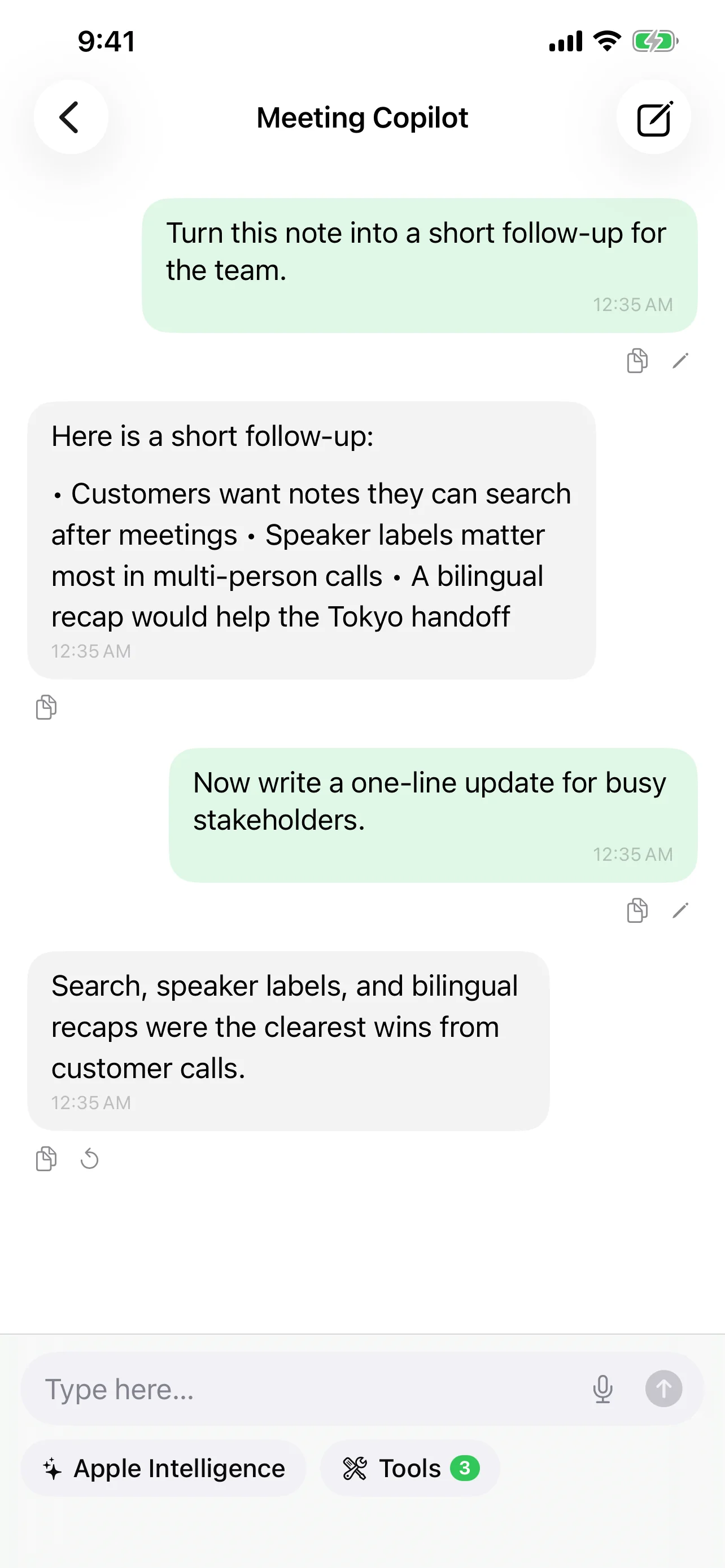

시나리오 3: 자동 팔로업 — AI 에이전트가 회의 노트의 액션 아이템을 모니터링. 새로운 약속이 감지되면 리마인더 생성, 팔로업 메시지 초안 작성, 프로젝트 트래커 업데이트를 실행.

에이전트의 미래: 음성이 퍼스트 클래스 시민으로

AI 워크플로에서 나타나는 패턴은 명확합니다: 에이전트는 실제 업무가 이루어지는 데이터에 접근해야 합니다. MCP를 통해 음성 녹음은 정적인 오디오 파일이 아닌, AI 에이전트가 상호작용할 수 있는 실시간 쿼리 가능한 데이터 소스가 됩니다.

- 대화를 녹음

- Speechy가 전사하고 AI 생성 메타데이터로 인덱싱

- AI 에이전트가 MCP를 통해 노트를 쿼리하여 인사이트 도출

- AI 메모리 시스템이 대화에서 장기 컨텍스트 구축

- 시스템이 이력을 이해하므로 미래 쿼리가 더욱 관련성 높아짐

시작하기

- Speechy 설정에서 MCP 활성화 — AI 설정 패널에서 MCP 서버를 활성화.

- AI 제공업체 선택 — Apple Intelligence, Claude, GPT-4.1, Gemini, 로컬 MLX 모델 중 선택.

- AI 에이전트 연결 — MCP 호환 에이전트(Claude Desktop, 커스텀 에이전트 등)를 Speechy의 MCP 엔드포인트에 연결.

- 쿼리 시작 — 에이전트가 음성 노트 검색, 전사본 조회, AI 생성 요약 및 액션 아이템에 접근 가능.

프라이버시와 제어

Speechy의 MCP는 앱의 다른 기능과 동일한 로컬 우선 철학을 따릅니다. 도구 호출은 기기에서 실행됩니다. 음성 데이터는 명시적으로 연결한 에이전트에만 노출되며, 클라우드 릴레이, 제3자 인덱싱, 통제 밖 데이터 유출이 없습니다.